De Spoon à Pepper en passant par NAO, Buddy, Jibo ou encore Leka, avez-vous remarqué que les robots interactifs se multiplient et commencent à être mis à disposition du grand public ? Savez-vous quelle est leur raison d’être et pourquoi ils sont tous plus mignons les uns que les autres ? La question n’est pas aussi naïve qu’elle en a l’air. En effet, la robotique n’étant plus circonscrite aux seuls laboratoires de recherche universitaire ou à l’industrie, ses avancées techniques et potentiel économique très prometteur conduisent un nombre croissant d’entreprises privées à s’inscrire dans un tournant social et émotionnel de la robotique. Le champ des interactions Humain-Machine (IHM) compte désormais parmi ses thématiques phares des domaines de recherche tels que la socialité artificielle et l’informatique affective. Mais pourquoi nos robots deviennent-ils « empathiques » ?

Signalons qu’il s’agit du thème de la prochaine rencontre organisée par le Mouton Numérique le jeudi 12 avril à 19h30 au 104. Serge Tisseron, psychiatre membre de l’Académie des technologies, et Jérôme Monceaux, Président de Spoon Artificial Creatures, ancien co-fondateur d’Aldebaran Robotics (aujourd’hui Sofbank Robotics) proposeront leurs réponses à cette question en éclaircissant les concepts de « robot social » et d’ « empathie artificielle ».

La robotique sociale

Pour bien comprendre ce devenir-émotionnel des artefacts, il est nécessaire de définir ce qu’est un robot empathique. Il est d’ailleurs plus juste de parler de robot sociable ou de robotique sociale (social robotics) car la socialité dite artificielle, c’est-à-dire le domaine de recherche visant à rendre les artefacts capables de simuler des comportements sociaux, inclut la modélisation et la simulation d’émotions sans s’y résumer.

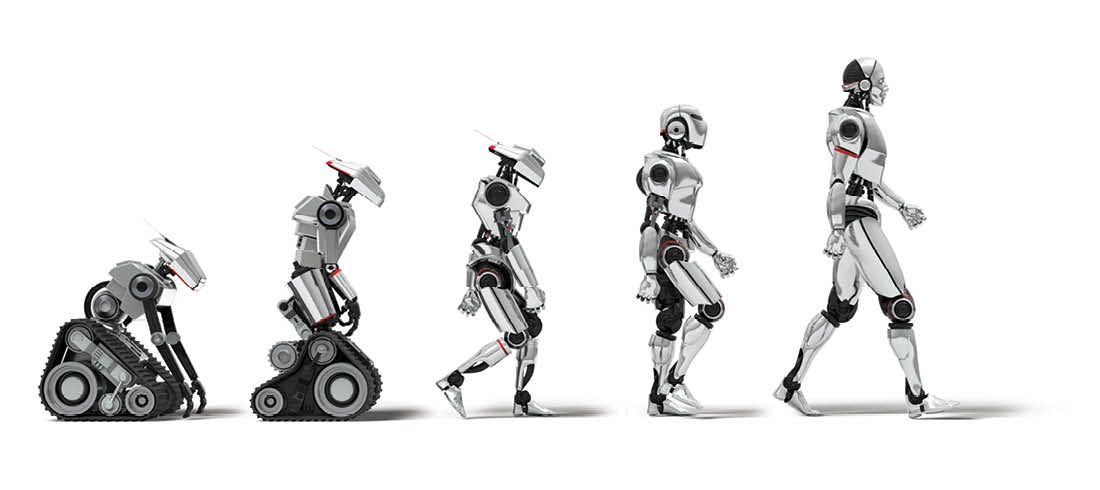

J’ai pour habitude de définir le robot comme un dispositif mécatronique conçu pour effectuer de façon autonome ou semi-autonome[1] des tâches 1) que l’humain ne veut pas effectuer (robots aspirateurs), 2) ne peut pas effectuer (robots industriels de haute précision chirurgicale, de déminage ou d’exploration des fonds marins) ou 3) avec plus d’efficacité et/ou d’efficience que si l’humain s’en chargeait (chaînes de montage). Le robot se présente d’emblée comme un objet utilitaire, un outil ; ce que ne dément pas son étymologie, robota signifiant « corvée », « travail forcé » en Tchèque. Or, nous allons voir que le robot social ne correspond plus tout à fait à cette définition.

Initialement, la robotique sociale cherchait à concevoir des robots capables d’interagir entre eux.

Initialement, la robotique sociale cherchait à concevoir des robots capables d’interagir entre eux.

Des machines qui ne servent à rien ?

Comme je l’ai brièvement évoqué, le versant social de la robotique se donne pour objectif de concevoir des artefacts capables de reproduire des comportements sociaux. Il peut s’agir d’une simulation de regard, de curiosité, de peur, du respect du tour de rôle dans la prise de parole ou encore de l’adoption d’un certain type de politesse dans l’interaction. Ceci étant dit, on peut légitimement se demander pourquoi une telle socialisation des robots est recherchée puisque ces derniers sont conçus pour être des outils, c’est-à-dire des moyens au service d’une fin. Mais c’est précisément sur cette question de l’utilité que la robotique sociale se démarque du reste de l’industrie. Le sociobot[2] est une entité déroutante car, en apparence, il ne semble rien posséder en propre : j’entends par là que tout ce qu’il fait pourrait être accompli par un autre artefact. Quel est donc son facteur différentiant ?

Si l’on en croit Takanori Shibata, concepteur du robot phoque Paro[3], l’horizon ultime de la socialité artificielle est la création de robots qui ne servent à rien en particulier car potentiellement capables de tout – à l’image de la socialité elle-même qui sert à tout en ne servant à rien en particulier. Cette aspiration à l’omnitélie qui caractérise la robotique sociale, c’est-à-dire à la volonté de concevoir une entité sachant tout faire, utile en toutes circonstances, rompt avec les logiques traditionnelles de conception où un artefact donné est développé en vue d’une fin particulière. En dehors du secteur médical au sens large, peu de sociobots sont conçus avec un objectif utilitaire précis. Les robots sociaux sont des plateformes à potentiels. C’est leur design et leur comportementalisation qui, dans un premier temps, priment pour les concepteurs, pas leur utilité. Il est vrai que certains d’entre eux intègrent des fonctions à faible valeur ajoutée déjà disponibles sur nos téléphones (agenda, photographie, lancement de liste de lecture etc.), mais celles-ci ne sont pas tant recherchées pour elles-mêmes que pour leur mode d’activation socialisée. Bien qu’il ne s’agisse pas d’un robot, le sésame vocal « Okay, Google… » nécessaire à l’utilisation de l’enceinte « intelligente[4] » Google Home illustre bien cette idée.

À l’heure actuelle, l’intérêt premier du robot social n’est donc pas à chercher dans sa ou ses fonctionnalités, mais dans la socialisation de son utilité potentielle. Il reste qu’utilité socialisée ne rime pas nécessairement avec utilité sociale…

Pourquoi rendre nos machines « sociables » ?

« Sociable » est l’adjectif caractérisant une personne apte à vivre en société[5]. La robotique sociale cherche donc à concevoir des artefacts pourvus d’une telle aptitude. La socialité est ici perçue comme un gage d’acceptabilité des robots par le grand public. En effet, leurs concepteurs postulent que nous serons d’autant plus enclins à accueillir favorablement les robots qu’ils seront dotés d’une « intelligence » sociale similaire à la nôtre, au moins sur ses bases. En philosophie, on dirait que ce mimétisme conduit à une réduction du fossé ontologique entre l’humain et la machine, interrogeant les catégories selon lesquelles nous nous pensons habituellement ce couple créateur/créature. La dimension émotionnelle de la socialité artificielle répond en grande partie à cet impératif d’acceptabilité. Comme l’affirme Serge Tisseron, « [un robot] n’aura pas plus de cœur qu’une machine à laver, mais à la différence de celle-ci, il sera capable de simuler l’affection que tout être humain attend de ses semblables – ou au moins de certains d’entre eux. Et c’est ce qui donnera envie de l’acheter ! En effet, nous n’avons guère envie d’héberger sous notre toit une créature de métal qui nous batte constamment aux échecs ou au Memory, qui nous demande si nous avons bien pris nos médicaments et nous rappelle l’heure d’aller nous coucher. Ce n’est donc pas l’intelligence des robots qui sera mise en avant pour nous convaincre d’en acheter, mais leur « cœur ». L’intelligence artificielle fait peur, l’empathie artificielle sera là pour nous rassurer.[6] » Bien que Tisseron sous-estime certainement le potentiel commercial de l’IA nouvellement prise en otage par le marketing – comme l’atteste cette publicité Huawei[7] -, il est vrai que les émotions informatiquement simulées[8] (EIS) peuvent servir la cause des sociobots, notamment grâce à l’attachement qu’elles susciteront chez leurs possesseurs. En d’autres termes, le devenir-émotionnel des artefacts permet de lutter contre l’ « effet Terminator ». Par ailleurs, l’importance des EIS ne tient pas qu’à la capacité des robots à simuler des émotions ou à en susciter en nous, mais également à celle de détecter[9] les nôtres et de s’y adapter : ce que Tisseron nomme « empathie artificielle ». Si les sociobots sont destinés à devenirs des partenaires existentiels, il est nécessaire de veiller à ce que les conditions de bonne cohabitation soient respectées. L’empathie artificielle est une des pistes suivies pour prévenir le rejet des robots par la population : elle aurait la vertu de générer chez l’utilisateur le sentiment d’être compris par l’artefact, d’empêcher les dissonances comportementales, bref de parer au risque qu’Arnold Schwarzenegger détruise le chauffeur de taxi à chaque course, pour les connaisseurs.

Du bon usage des émotions en robotique sociale : la technopraxie

Ces différents partis pris qui, disons-le, sont loin d’être sortis du chapeau des roboticiens, ne sont pas exempts d’interrogations. Pour Tisseron, l’un des principaux risques liés à l’empathie artificielle est celui de la préférence ontologique. Bien qu’il n’utilise pas cette formule, c’est bien de cela dont il s’agit : le psychiatre craint qu’une proportion non négligeable d’entre nous finisse par préférer interagir avec des robots programmés pour ne jamais nous décevoir qu’avec nos semblables humains. Mais là n’est pas le seul enjeu soulevé par le sujet. Comment ne pas penser à l’énorme potentiel de persuasion que ces machines pourraient avoir sur les jeunes générations natives de l’ère numérique ? Comment éviter que ces machines sombrent dans les pratiques captologiques les moins scrupuleuses et ne deviennent des « chevaux de Troie émotionnels » de puissances dont l’intérêt ne réside pas nécessairement dans le bien commun ?

Pour répondre à ces questions qui ne représentent, bien sûr, qu’une partie des incertitudes soulevées par la thématique, une technologie, au sens de discours sur la technique (techno-logos) est nécessaire, mais elle doit se concrétiser dans ce que j’appelle une technopraxie appliquée à la robotique sociale, c’est-à-dire une pratique vertueuse des artefacts, tant au niveau de la conception que de l’usage. Les rencontres comme celles organisées par le Mouton Numérique sont très précieuses d’un point de vue technologique, mais doivent trouver des relais technopraxiques. C’est malheureusement souvent là que le bât blesse. Une des voies possibles pour pallier ce déficit technopraxique serait de développer les financements CIFRE (Conventions Industrielles de Formation par la Recherche) pour les doctorants en sciences humaines et sociales (SHS). La Technique n’est pas qu’une affaire de techniques : elle est un écosystème où interagissent différents savoirs et intérêts scientifiques, culturels et sociaux. Pour employer une métaphore dualiste, si la technique forme le corps des artefacts, les SHS en sont l’âme.

Un article de Julien De Sanctis Toutes ses publications

[1] Par autonomie, il faut entendre la capacité, au moins partielle, d’agir par lui-même sur le réel, et de faire face à l’imprévu. Cette autonomie peut être opérationnelle ou décisionnelle.

[2] J’utilise ce néologisme comme synonyme de robot social.

[3] Paro est un robot phoque en peluche utilisé en « thérapie animale », notamment avec les personnes âgées et les patients atteints de la maladie d’Alzheimer.

[4] Il y aurait beaucoup à dire sur ce qualificatif…

[6] Ibid., p.11

[7] Ce qui n’est pas sans révéler le paradoxe dans lequel nous sommes tous pris à des degrés, à savoir que nous craignons l’IA tout en la désirant, et qui fait de nous des moutons (noirs) numériques.

[8] Je préfère la formule d’émotion informatiquement simulées à celles, trop floue donc peu rigoureuse, d’émotions artificielles.

[9] Une rhétorique peu scrupuleuse dirait « comprendre ». Pourquoi pas, mais il s’agit de le démontrer. C’est là que le bât blesse.

2 commentaires pour “Micro enquête sur le devenir-émotionnel des robots”